استقلالية البشر في نهضة الذكاء الاصطناعي التوليدي

استقلالية البشر في نهضة الذكاء الاصطناعي التوليدي

تشريعات حوكمة البيانات تمنح الأفراد حق «إقصاء» بياناتهم من نظام معين، كما هو الحال مع لائحة سدايا (PDPL) ولائحة الاتحاد الاوروبي (GDPR)

لكن التحدي يكمن في وضوح ما خلف الستار، اليوم تتداخل الأنظمة التقليدية مع شتى مراحل دورة البيانات، وقابلية التفسير مقبولة الى حد كبير، أما مع الذكاء الاصطناعي التوليدي تتفاقم محدودية التفسير بشكل استثنائي

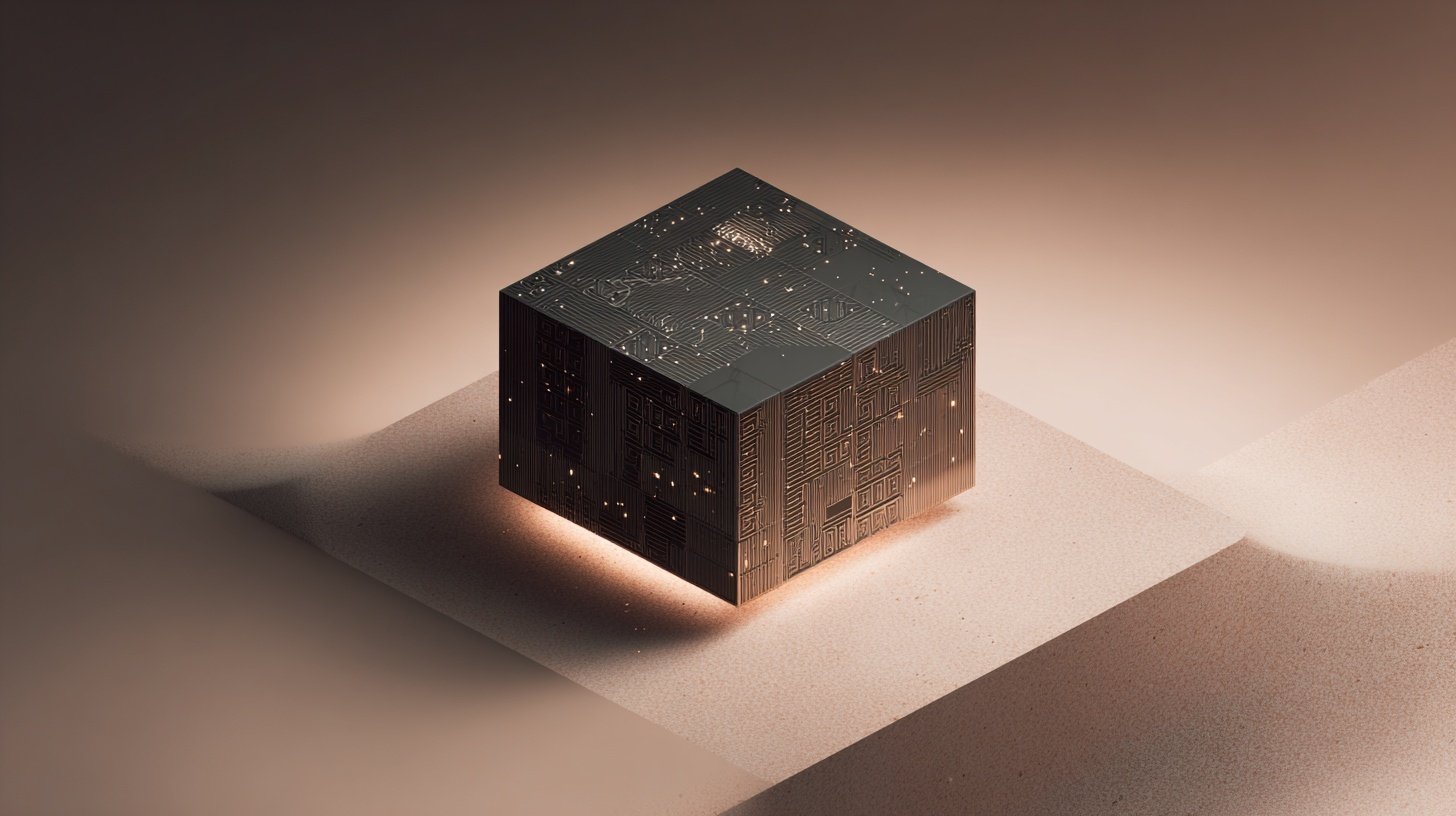

حيث أنه يُغرق شفافية البيانات بطبيعة تدريبه، النظام لا يستطيع شرح لماذا انتج هذا المُخرج، أو على ماذا استند، هذه الحالة تجسّد مفهوم الصندوق الأسود (BlackBox)

من ضمن الحلول نجد اهتمام بحثي متزايد بالذكاء الاصطناعي التفسيري وأيضًا في نبذ/عدم التعلم (Machine Unlearning)

حيث يسعى المفهوم الأول لتوضيح دوافع النموذج حول الرد وزيادة الشفافية، والآخر يمكّن النموذج من إقصاء أو نسيان بيانات معينة تدرب عليها دون الضرر بكامل عملية التدريب